―日本のロボット開発の現状をどのように見ていらっしゃいますか?

東京大学 石川正俊

日本のロボット開発は随分と進んでいますが,ロボットを議論する際,産業用ロボットとそれ以外のロボットとに分けて考えないといけません。産業用ロボットでは、プレイバックで同じ動作を繰り返すというものから対象物の状況を把握してそれに合わせて動作する方向へと進んでいます。

これをAIの問題ととらえると、人間的な動きをするという考え方がその一つにあります。これは私の考えですが,人間的な動きをするというのがロボットではなくて、ロボットというのは機械システムとして本来の働きをしなければならないと思っています。産業用ロボットは物理的な速度限界はあるものの,動作スピードは速いですが、AI系のロボットは遅いのです。これだと機械システムの性能を無駄遣いしているのではないかと思ってしまいます。では、速度限界に近づけるにはどうしたら良いかということになりますが,その答えは知能を高速化させるということになります。これはなかなか大変なことだろうとは思います。

―では、先生が狙っているところとは?

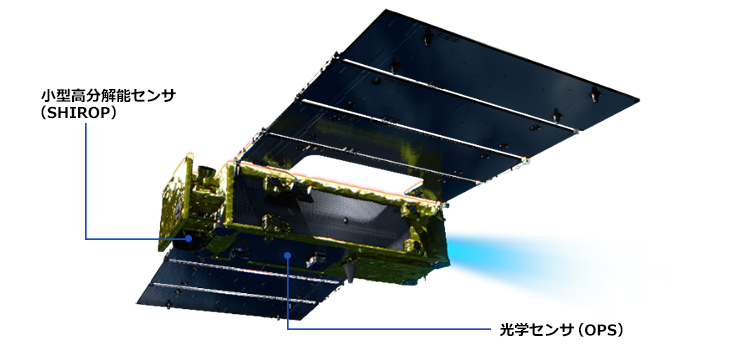

産業用ロボットの知能を高めていくことです。そのためには,センサーとアクチュエータの高速化,高精度化が重要になります。センサーに関しては,その機能はかなり高まってきていますが,要求速度は先ほど申し上げたように1/1,000秒なので,これに対応するための開発が必要です。特に一般的な光センサーは遅いので、それを如何に高速化させるかが課題です。

―高速ビジョンセンサーについて詳しく教えてください。

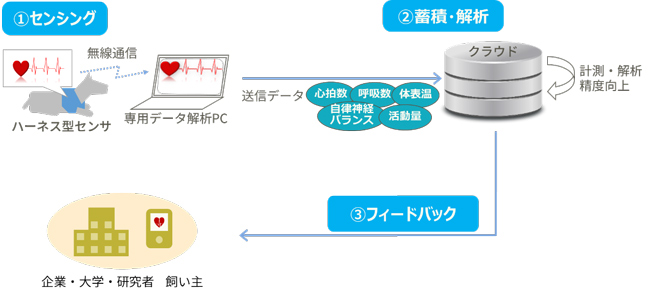

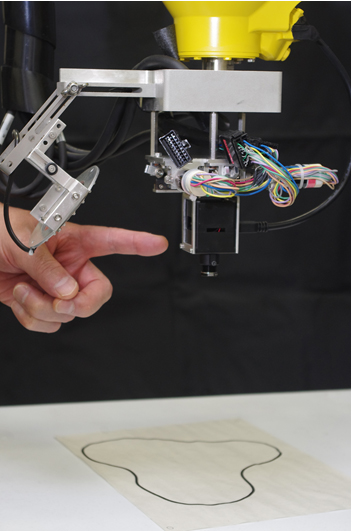

石川教授の研究室とソニーが共同開発した高速ビジョンセンサーをパラレルリンクロボットの先端に搭載。

我々の研究室とソニーとが共同で開発したもので,ソニーが実用化を発表しています。この成果をこの2月に開催されたISSCCで発表しましたが,我々の研究室ではこれを搭載したパラレルリンクロボット(ファナック製)を用い,高速画像認識技術などの研究開発を進めています。このチップはcolumn parallelという方式で,1/1,000秒で画像処理ができるものです。1番上の層に1/1,000秒でも感度が高いイメージャーがあり,二層目にAD変換が約1,300個,4bitと1bitプロセッシングエレメント(PE)も約1,300個が並列実装されています。フレームレートは,フル解像度で500 fps(2メガピクセル4 bit)。それを1/4にした0.3メガピクセルで1,000fpsになります。これを例えばGPUでやろうとしたら何十Wという消費電力が必要ですが,このチップはわずか363mWです。

―具体的にどのようなインパクトがあるのでしょうか?

それはロボットを止める必要がなくなるということです。現状は、ロボットが三次元形状計測を行なう際には毎回動作を止める必要があります。止まって画像計測を行ない,それに合わせて動作し,また画像計測を行なうのに止まるのを繰り返すわけです。その間に揺れてしまうという問題もあります。

―AI系ロボット側から見るといかがでしょうか?

三次元形状計測は出来ていますが,先ほども申し上げたようにスピードが遅いという問題があります。高速化するにはセンサーのことが分かっていないといけません。いま期待されているのはTOF方式センサーですが,自己位置推定の高速化も必要です。

―ロボットと光技術との融合の可能性について、どのようにお考えでしょうか

大きく分けて3つの流れがあります。

二つ目は配線です。ロボットにはセンサーからコントローラーまで必ず配線が通ります。その配線をどうにかして光化できないものかと考えています。電力線の光化は難しいと思いますが,例えば,触覚センサーなど何かしらのセンサーを搭載するとなると膨大な配線が必要になります。これを光通信させることができないかと思っています。自由空間通信になるので難しいところもあるのですが,配線をどうにか光に高度化してロボットの邪魔にならないようにできれば良いと思っています。実は配線の扱いは大変なんです。ロボットが回転すると配線も一緒に回るので、断線する可能性があります。私の研究室でも断線はしょっちゅう起こります(笑)。

三つ目は,空間精度と時間精度を対象にしたセンサーの実現です。我々が研究を進めているデザインコンセプトにダイナミクス制御があります。時間・空間両方のダイナミクスをサンプリング定理以上のところで、全てカバーするという考え方です。サンプリング定理では対象の帯域の倍を計測すれば良いのですが、それ以上のことを時間・空間で計測できるセンサー・システムの構築が望まれています。

もう一つ挙げるとすれば,光学系の高速化にも期待したいところです。アクティブビジョンやアクティブオプティクスというのがありますが、例えば,焦点距離を可変にするズームレンズの動きは非常に遅い。これを1/1,000秒で実現してもらいたいと思っています。せっかく1/1,000秒のチップができても焦点面だけの話ですよね。絞りはある程度速いのですが、ズームと焦点調節は今のスピードではロボットに足りません。

―先生はセキュリティ分野のご研究もされているのでしょうか?

もちろんメインテーマは高速のロボットです。我々が目指す世界には人間の目をまねたような光センサーではなくて,人間の目を超えてさらに光素子の限界,機械システムの限界を超えるような光センサーが必要です。人間の目で動きが見えるようであればそのロボットは遅いんです。動きが見えるようでは機械の限界に達していない。だから機械の限界に挑戦する。見えないスピードで動かないといけないというのが,私のロボットのイメージです。

(月刊OPTRONICS 2017年12月号より転載)