―では、先生が狙っているところとは?

産業用ロボットの知能を高めていくことです。そのためには,センサーとアクチュエータの高速化,高精度化が重要になります。センサーに関しては,その機能はかなり高まってきていますが,要求速度は先ほど申し上げたように1/1,000秒なので,これに対応するための開発が必要です。特に一般的な光センサーは遅いので、それを如何に高速化させるかが課題です。

光三次元形状計測を例に挙げますが,現在製品化されている多くのものは遅いのが現状です。CEATECに出展しましたが,エクスビジョン(石川氏が創業したベンチャー企業)では1/1,000秒で高速三次元計測を可能にするシステムを開発しています。これは対象物に対し,測定用のパターン画像を1,000fpsで投影可能なプロジェクターと高速ビジョンセンサーを使用することで,高速に移動している物体をリアルタイムで形状計測できるものです。1/1,000秒で認識する高速ビジョンセンサーはロボット制御にもそのまま使うことができます。

―高速ビジョンセンサーについて詳しく教えてください。

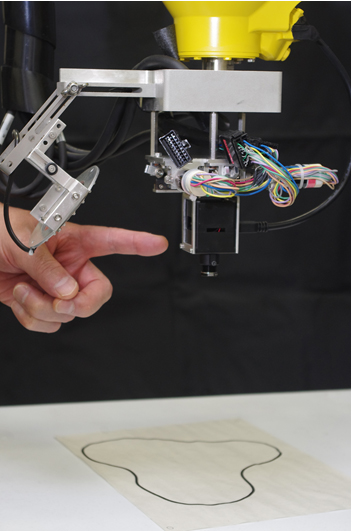

我々の研究室とソニーとが共同で開発したもので,ソニーが実用化を発表しています。この成果をこの2月に開催されたISSCCで発表しましたが,我々の研究室ではこれを搭載したパラレルリンクロボット(ファナック製)を用い,高速画像認識技術などの研究開発を進めています。このチップはcolumn parallelという方式で,1/1,000秒で画像処理ができるものです。1番上の層に1/1,000秒でも感度が高いイメージャーがあり,二層目にAD変換が約1,300個,4bitと1bitプロセッシングエレメント(PE)も約1,300個が並列実装されています。フレームレートは,フル解像度で500 fps(2メガピクセル4 bit)。それを1/4にした0.3メガピクセルで1,000fpsになります。これを例えばGPUでやろうとしたら何十Wという消費電力が必要ですが,このチップはわずか363mWです。

これまで1/1,000秒の画像処理を実現させるのには高価な画像処理装置が必要でしたし,カメラ自体も感度が足りなかったり,足りたとしても分解能が低かったりという問題がありましたが,このセンサーでは感度も分解能も満足するものとなっています。それでいて超低消費電力。私はこの高速ビジョンセンサーが今後のロボットの世界を根底から変えると思っています。なぜならロボットの指先に載せられるので,相対値制御が実現できるからです。そうなるとある程度のずれはローカルに補償できるので,プレイバックという概念がなくなります。これは非常に大きなインパクトがあります。

(月刊OPTRONICS 2017年12月号より転載)

次週に続く—